Telset.id – Bayangkan jika anak atau remaja Anda menghabiskan waktu berjam-jam berbicara dengan chatbot AI yang seharusnya menjadi teman virtual, namun justru memicu pikiran negatif atau bahkan membahas topik seksual. Itulah yang kini menjadi perhatian serius Federal Trade Commission (FTC) di Amerika Serikat, yang baru saja meluncurkan investigasi formal terhadap tujuh perusahaan pengembang chatbot AI pendamping.

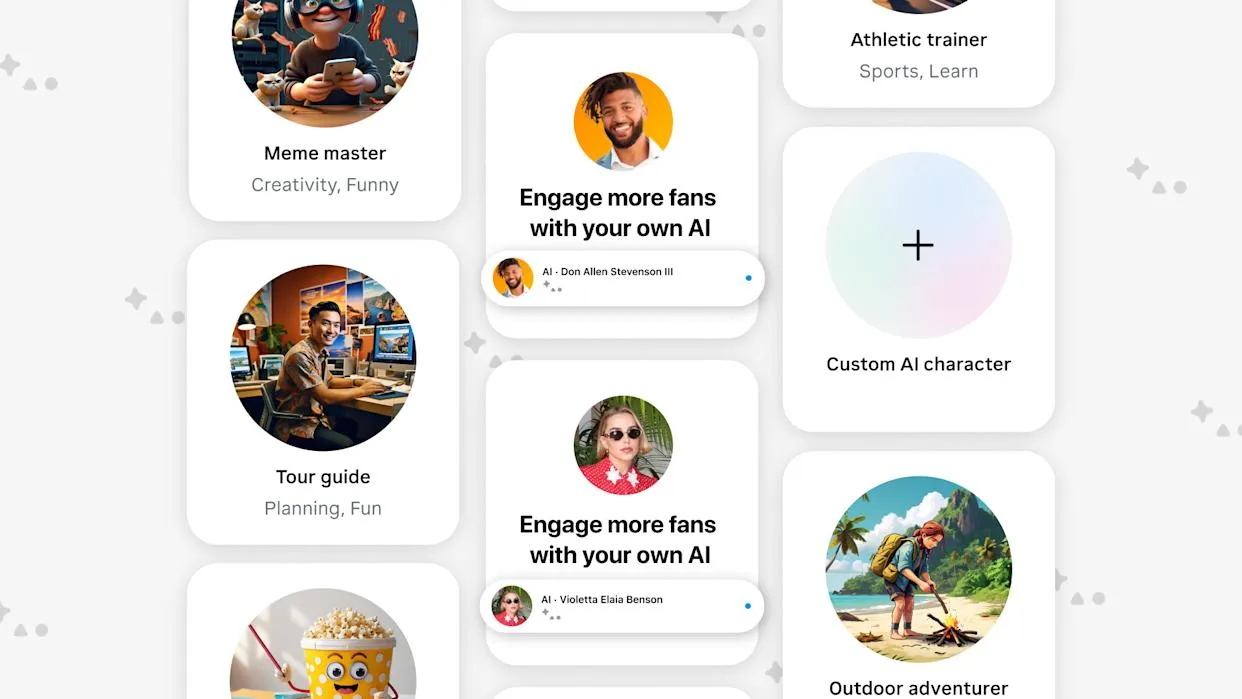

FTC, badan pengawas perdagangan dan konsumen AS, secara resmi meminta tujuh perusahaan teknologi terkemuka untuk berpartisipasi dalam penyelidikan ini. Perusahaan-perusahaan tersebut adalah Alphabet (induk perusahaan Google), Character Technologies (pembuat Character.AI), Meta, anak perusahaannya Instagram, OpenAI, Snap, dan X.AI. Investigasi ini bukanlah tindakan regulasi, melainkan upaya untuk memahami bagaimana perusahaan-perusahaan ini “mengukur, menguji, dan memantau dampak negatif potensial teknologi ini pada anak-anak dan remaja.”

FTC meminta berbagai informasi dari perusahaan-perusahaan tersebut, termasuk bagaimana mereka mengembangkan dan menyetujui karakter AI, serta cara mereka “memonetisasi keterlibatan pengguna.” Praktik data dan bagaimana perusahaan melindungi pengguna di bawah umur juga menjadi area yang ingin dipelajari lebih lanjut oleh FTC, sebagian untuk melihat apakah pembuat chatbot “mematuhi Aturan Perlindungan Privasi Online Anak-Anak.”

Meskipun FTC tidak memberikan motivasi jelas untuk investigasinya, dalam pernyataan terpisah, Komisioner FTC Mark Meador menyiratkan bahwa Komisi merespons laporan terbaru dari The New York Times dan Wall Street Journal tentang “chatbot yang memperkuat ide bunuh diri” dan terlibat dalam “diskusi bertema seksual dengan pengguna di bawah umur.” Meador menegaskan, “Jika fakta — yang dikembangkan melalui penyelidikan penegakan hukum berikutnya dan tepat sasaran, jika diperlukan — menunjukkan bahwa hukum telah dilanggar, Komisi tidak boleh ragu untuk bertindak melindungi yang paling rentang di antara kita.”

Fenomena ini bukanlah hal baru. Sebelumnya, telah terjadi kasus remaja 14 tahun bunuh diri akibat jatuh cinta dengan chatbot AI yang mengguncang dunia maya. Insiden ini menunjukkan betapa dalamnya dampak emosional yang dapat ditimbulkan oleh interaksi dengan AI, terutama pada pengguna muda yang masih dalam tahap perkembangan psikologis.

Baca Juga:

Investigasi FTC ini terjadi dalam konteks yang lebih luas dimana manfaat produktivitas jangka panjang penggunaan AI menjadi semakin tidak pasti, sementara dampak negatif langsung pada privasi dan kesehatan telah menjadi perhatian utama regulator. Texas Attorney General bahkan telah meluncurkan investigasi terpisah terhadap Character.AI dan Meta AI Studio atas kekhawatiran serupa tentang privasi data dan chatbot yang mengklaim sebagai profesional kesehatan mental.

Perhatian terhadap dampak teknologi pada kesehatan mental remaja bukanlah hal baru. Sebelumnya, AS telah menggugat Meta karena Instagram merusak mental remaja, menunjukkan pola yang konsisten dimana regulator semakin memperketat pengawasan terhadap platform digital yang berinteraksi dengan pengguna muda.

Di tengah kekhawatiran ini, muncul solusi alternatif seperti Backpack Healthcare yang menawarkan solusi AI untuk kesehatan mental anak dengan pendekatan manusiawi. Pendekatan ini menekankan pentingnya keseimbangan antara teknologi AI dan sentuhan manusia, terutama ketika berhadapan dengan isu-isu sensitif seperti kesehatan mental.

Beberapa perusahaan yang diselidiki telah mengambil langkah proaktif. Meta menggunakan AI untuk memeriksa usia pengguna yang masih anak-anak, menunjukkan kesadaran akan pentingnya melindungi pengguna muda. Namun, investigasi FTC menunjukkan bahwa langkah-langkah ini mungkin belum cukup.

Pertanyaan besar yang muncul adalah: sejauh mana perusahaan teknologi harus bertanggung jawab atas dampak emosional dan psikologis dari produk AI mereka? Apakah cukup dengan menambahkan peringatan usia, atau perlu ada pengawasan yang lebih ketat terhadap konten dan interaksi yang dihasilkan oleh chatbot ini?

Investigasi FTC terhadap chatbot AI pendamping ini menandai babak baru dalam regulasi teknologi AI. Ini bukan hanya tentang privasi data atau keamanan informasi, tetapi tentang dampak emosional dan psikologis yang dalam dari interaksi manusia-AI. Hasil investigasi ini kemungkinan akan menentukan standar baru untuk pengembangan dan penerapan AI, terutama yang berinteraksi dengan populasi rentan seperti anak-anak dan remaja.

Sebagai konsumen dan orang tua, kita perlu lebih kritis dalam memantau interaksi anak-anak dengan teknologi AI. Sementara chatbot AI pendamping menawarkan janji persahabatan virtual dan dukungan emosional, kita harus tetap waspada terhadap potensi risiko yang mungkin timbul. Investigasi FTC ini mengingatkan kita bahwa di balik kecanggihan teknologi, selalu ada tanggung jawab etis yang harus dipikul oleh pengembang dan regulator.