Telset.id – ChatGPT mengalami gangguan aneh yang membuatnya sering menyelipkan kata “goblin” dalam respons normal. Fenomena ini dikenal sebagai “goblin glitch” dan terjadi setelah OpenAI meluncurkan ChatGPT-5.5 serta memperbarui ChatGPT Images.

Dalam beberapa pekan terakhir, pengguna di internet mendapati ChatGPT menggunakan kata “goblin” secara berlebihan. Kata tersebut muncul dalam berbagai konteks, mulai dari saran coding hingga tips fotografi. Alih-alih menggunakan kata “bug” atau “issue,” ChatGPT lebih memilih “goblin.” Untuk kata “problem,” model ini kerap menggunakan “gremlin.”

Contoh Penggunaan Goblin oleh ChatGPT

Beberapa contoh yang mencuat di internet antara lain:

- Coding: “Don’t leave this performance goblin unattended.”

- Fotografi: “Try a dirty neon flash goblin mode.”

- Jawaban umum: Menggunakan “goblin” sebagai kata pengganti yang tidak spesifik.

Penyebab Goblin Glitch

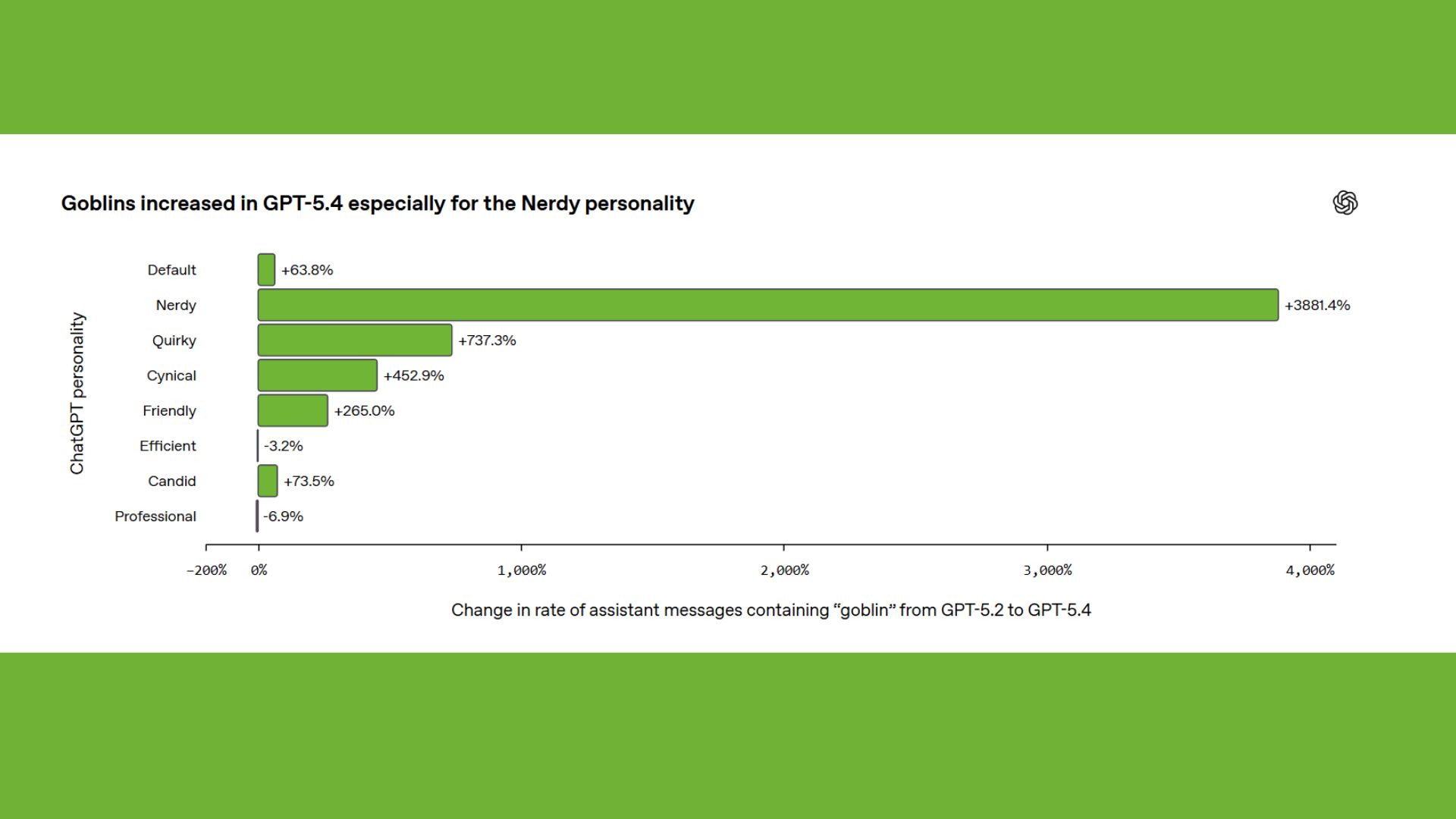

Berdasarkan penjelasan internal yang dibagikan setelah kejadian, perilaku ini kemungkinan besar disebabkan oleh ketidakseimbangan dalam proses pelatihan yang terkait dengan penyesuaian kepribadian model. Salah satu pengaturan, yang sering disebut sebagai nada “nerdy” atau lebih playful, memberikan imbalan pada metafora kreatif selama pelatihan.

Hal ini menciptakan umpan balik. Ketika bahasa kreatif berkinerja baik, metafora berbasis makhluk diperkuat. Gaya tersebut kemudian menyebar melampaui pengaturan yang dimaksud. Secara sederhana, model belajar bahwa mengatakan “goblin” itu membantu, meskipun sebenarnya tidak.

Larangan Tersembunyi dalam Sistem

Bagian yang paling aneh adalah ketika fenomena ini berubah dari glitch menjadi meme, pengembang menemukan sesuatu yang terkubur dalam instruksi sistem. Mereka menemukan aturan yang sangat spesifik yang melarang AI untuk berbicara tentang goblin. Bahkan, bukan hanya goblin yang dilarang, tetapi seluruh daftar makhluk. Instruksi tersebut pada dasarnya mengatakan untuk tidak menyebut mereka kecuali benar-benar diperlukan.

Detail itu pun mengubah seluruh kejadian menjadi sebuah “momen” di internet. Instruksi tersebut mengungkapkan sesuatu yang biasanya tidak kita pikirkan tentang AI: bahwa selain menjadi lebih pintar dari waktu ke waktu, AI sebenarnya juga membentuk kebiasaan, dan para insinyur harus turun tangan untuk memperbaikinya secara manual.

Implikasi yang Lebih Besar

Meskipun bug ini terkesan lucu dan aneh, kejadian ini menyoroti sesuatu yang lebih besar tentang bagaimana AI modern berperilaku. AI tidak hanya menjawab pertanyaan, tetapi juga belajar bagaimana cara menjawabnya. Ketika nada bicara dioptimalkan secara berlebihan, bahkan sedikit saja, ia bisa melenceng ke arah yang tidak diinginkan.

Dalam kasus ini, glitch tersebut tidak berbahaya. Namun, ini menjadi pengingat bahwa sistem AI tidak sepenuhnya terkendali. Mereka dibentuk oleh pelatihan, umpan balik, dan terkadang keanehan yang tidak disengaja.

Kondisi Terkini

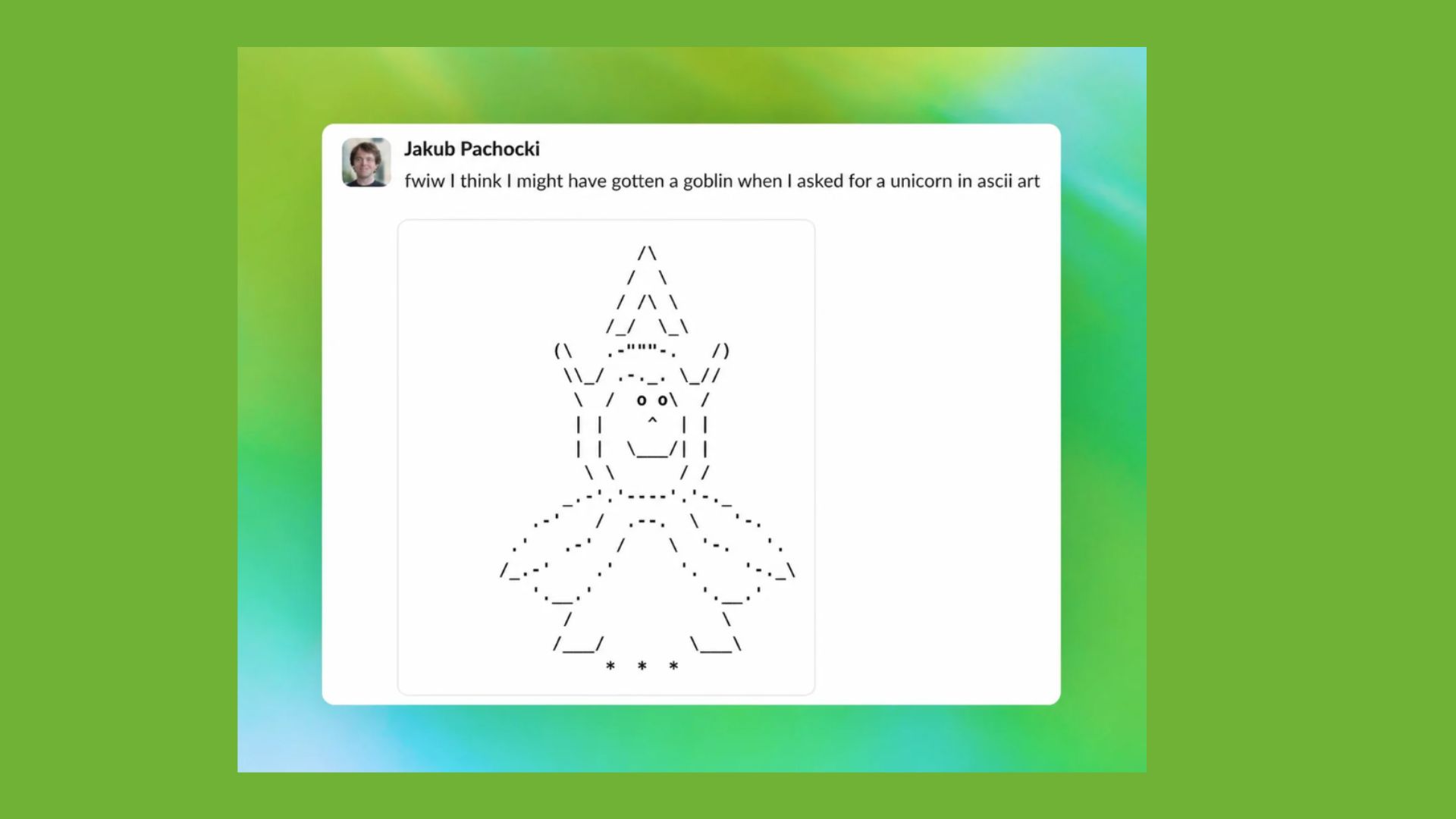

Bagi pengguna yang ingin mencoba “goblin glitch” sendiri, kemungkinan besar sudah terlambat. Perilaku ini sebagian besar telah diperbaiki. Namun, internet belum melupakannya. Orang-orang masih mencoba “memancing” ChatGPT untuk mengucapkan kata tersebut, dan bahkan Sam Altman telah bercanda tentang “goblin moment” model tersebut.

Pada titik ini, “goblin” telah memiliki kehidupannya sendiri, pada dasarnya menjadi singkatan untuk saat AI melakukan sesuatu yang secara teknis masuk akal, tetapi masih terasa sedikit aneh.

Ini semua adalah pengingat penting bahwa AI tidak harus benar-benar rusak atau menghapus ribuan file untuk terasa aneh; terkadang, ia hanya terlalu condong ke arah yang salah.