NVIDIA bergeser dari fokus pelatihan model ke era 'inferensi agen' dengan proyeksi permintaan infrastruktur AI mencapai $1 triliun pada 2027.

key_pointGPU Rubin R100 membawa 336 miliar transistor dan bandwidth memori 22 TB/s untuk menangani beban kerja agen AI yang intensif.

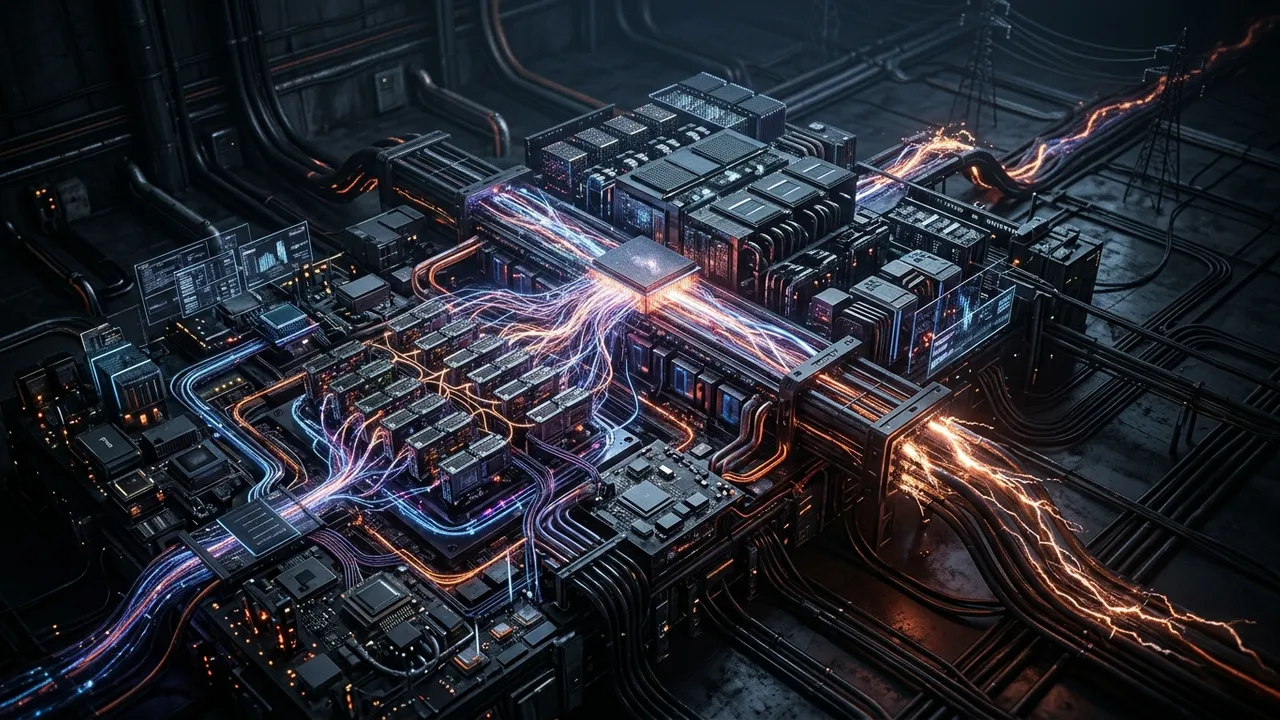

Satu rak NVL72 mengintegrasikan 72 GPU Rubin, memberikan kinerja inferensi 3,6 ExaFLOPS dengan efisiensi biaya 10x lebih murah.

NVIDIA mengakuisisi aset Groq untuk mengintegrasikan teknologi LPU guna menekan latensi inferensi yang tidak bisa dicapai GPU konvensional.

key_pointArsitektur masa depan Rubin Ultra memerlukan daya 600 kW per rak, memicu tantangan infrastruktur listrik yang sangat berat.